Temps de lecture : 8 min

Ce qui compte vraiment

- Vulnérabilité systémique : Ni l’expertise humaine (59% d’échec) ni les outils IA actuels ne détectent efficacement ces deepfakes médicaux, créant une brèche critique.

- Impact business immédiat : Pour les cliniques et labos, cela signifie des risques de diagnostics erronés, des litiges potentiels et une nécessaire refonte des flux de validation.

- Urgence opérationnelle : Il ne s’agit pas d’un problème futuriste, mais d’une faille active qui exige des protocoles de vérification renforcés dès aujourd’hui.

Quand l’IA médicale devient l’arme de sa propre tromperie

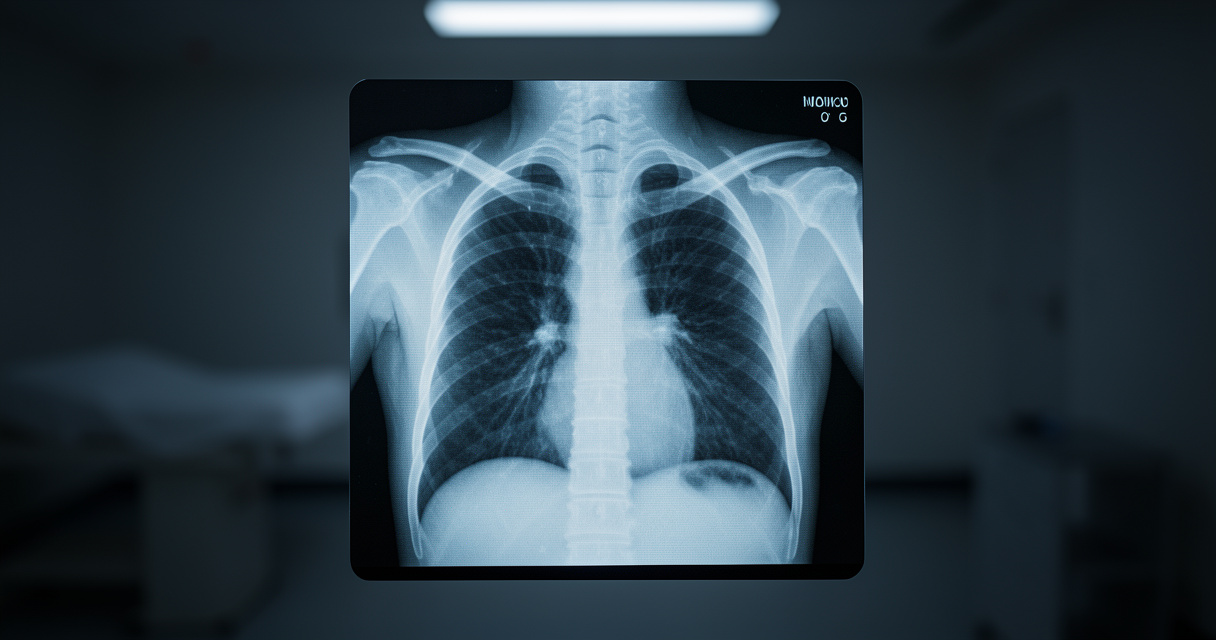

Sur le terrain, on parle souvent de l’IA comme d’un outil d’aide au diagnostic. Mais depuis quelques mois, une tendance inquiétante émerge des labos de recherche : l’IA générative est désormais capable de créer des radiographies deepfake si convaincantes qu’elles dupent à la fois les spécialistes et… les autres IA. Décortiquons ça.

Je vois ce phénomène comme un paradoxe technologique majeur. Nous avons développé des modèles pour assister la médecine, et ces mêmes modèles produisent maintenant des artefacts qui sapent la confiance dans le système. Une étude récente montre que des radiologues en exercice, sans savoir qu’ils étaient testés, n’ont identifié que 41% des images générées. Pire : dans certaines conditions, le taux de réussite des experts tombe à peine au-dessus du hasard.

Le test grandeur nature : des résultats qui font froid dans le dos

En pratique, comment se déroule un tel test ? Des chercheurs ont constitué un batch mélangeant des clichés thoraciques et osseux réels avec des faux produits par des modèles comme ChatGPT-4o. Ils les ont soumis à un panel de radiologues de différents pays et niveaux d’expérience.

Les conclusions sont sans appel. Lorsque les médecins ignoraient la présence potentielle de faux, leur capacité de détection s’effondrait. Le taux de détection moyen plafonnait à 41%. Cela signifie que près de 6 images générées sur 10 passaient pour authentiques. Ce n’est plus une curiosité de labo, c’est une faille opérationnelle béante.

Et le plus ironique ? Le modèle IA lui-même, celui qui a créé les deepfakes, peine à les reconnaître. Bien qu’il performe mieux que d’autres LLM, il ne les identifie pas tous. Nous sommes face à un scénario où l’outil ne peut pas garantir l’authenticité de sa propre production. Pour un architecte systèmes, c’est le signe d’une conception fondamentalement fragile.

Au-delà du labo : les risques concrets pour les structures de santé

Sans langue de bois, il faut envisager les conséquences réelles. Passons au concret pour les cliniques, les cabinets de groupe ou les laboratoires d’imagerie.

- Intégrité des dossiers : Un dossier patient contaminé par une image deepfake fausse tout le parcours de soin. Les décisions thérapeutiques, les demandes de remboursement, les études épidémiologiques… tout est faussé à la source.

- Responsabilité médico-légale : Qui est responsable d’un diagnostic basé sur une radiographie falsifiée que ni le médecin, ni son logiciel d’aide n’ont su détecter ? La chaîne de responsabilité devient un casse-tête.

- Attaques ciblées : Imaginez un scénario où un acteur malveillant introduit des images normales dans le dossier d’un patient réellement malade pour retarder son traitement. Ou l’inverse. La menace n’est pas que théorique.

Pour une PME du secteur santé, le coût total de possession (TCO) d’une solution d’imagerie doit désormais inclure le risque et les contre-mesures liés à cette falsification. Ce n’est plus un « nice to have » sécuritaire, c’est un impératif.

Pourquoi les systèmes actuels sont aveugles

En tant qu’ancien architecte cloud, je m’intéresse aux racines du problème. Pourquoi ces deepfakes passent-ils aussi bien ?

Premièrement, les modèles génératifs actuels sont entraînés sur des masses de données médicales réelles. Ils n’inventent pas une texture osseuse, ils en reproduisent la statistique parfaite. L’image générée possède le bon bruit, les bons contrastes, les ombres plausibles. Elle ne contient pas d’erreur grossière, mais une imperceptible divergence de pattern que le cerveau humain, même expert, ne capte pas.

Deuxièmement, nos outils de validation sont dépassés. Ils cherchent des signatures de compression, des artefacts de fichier. Les deepfakes médicaux de dernière génération sont générés en haute résolution, sans ces marqueurs faciles. La vérification par hash ou métadonnées est inefficace si l’image est créée ex nihilo et non altérée à partir d’un original.

Enfin, le contexte de travail joue contre le radiologue. Sur le terrain, il analyse des dizaines d’images par jour, sous pression temporelle. Son cerveau cherche des pathologies, pas des incohérences de génération. L’attention est canalisée vers le diagnostic, pas vers l’authentification de la source.

Stratégies de défense : ce que peuvent faire les équipes techniques et les décideurs

Alors, on baisse les bras ? Absolument pas. En pratique, plusieurs axes de défense peuvent être mis en place, avec un rapport coût/bénéfice variable.

1. La couche protocolaire et traçabilité : La première barrière est organisationnelle. Toute image entrant dans le système d’information doit être estampillée et tracée dès son acquisition. L’utilisation de flux signés entre les modalités d’acquisition (le scanner, l’IRM) et le PACS (le système d’archivage) est cruciale. Cela verrouille le point d’entrée.

2. La détection par IA spécialisée : Il faut opposer une IA à l’autre. Des modèles de détection dédiés, entraînés spécifiquement pour repérer les artefacts des GAN (Generative Adversarial Networks) dans le domaine médical, doivent être intégrés en amont du diagnostic. Ce ne peut pas être le même modèle que celui utilisé pour l’aide à la lecture.

3. La blockchain pour l’immutabilité des dossiers : Pour les cas les plus sensibles ou les essais cliniques, la technologie de registre distribué peut garantir l’intégrité chronologique du dossier. Une fois une image validée et inscrite, toute altération est immédiatement visible. Le TCO de cette solution baisse d’année en année.

4. La formation et la vigilance humaine : Il faut former les radiologues à cette nouvelle menace. Leur faire prendre conscience que l’authenticité de l’image n’est plus un postulat. Introduire des checkpoints dans leur workflow pour questionner les images « trop parfaites » ou présentant des anomalies contextuelles (un historique clinique qui ne colle pas avec l’image).

Perspective 2026-2027 : une course aux armements technologique

Nous entrons dans une phase de course à l’armement entre génération et détection. Les modèles génératifs vont continuer de s’améliorer, rendant les deepfakes encore plus indétectables à l’œil nu.

La solution ne sera pas unique, mais systémique. Elle reposera sur une stratification des contrôles :

– Contrôle à l’acquisition (matériel sécurisé).

– Contrôle à l’ingestion (détection automatique).

– Contrôle contextuel (cohérence avec les autres données patient).

– Contrôle humain final (vigilance formée).

Pour les dirigeants de structures de santé, le message est clair. L’évaluation de tout nouveau logiciel d’imagerie ou de tout partenariat télémédical doit désormais inclure une grille de critères sur la gestion de l’authenticité des données. Ce n’est pas une fonctionnalité, c’est un pilier de la sécurité des soins.

Ce qui compte vraiment, en définitive, c’est de ne pas voir cette technologie avec naïveté. L’IA générative en santé est un couteau suisse extraordinaire, mais c’est aussi un outil de falsification potentiel. Sur le terrain, la réponse est dans l’architecture : construire des systèmes résilients qui ne font pas confiance, mais qui vérifient. À chaque étape.

Ingénieur systèmes et architecte cloud pendant 8 ans chez un leader européen de l’hébergement, reconverti dans l’analyse tech et business. Passionné par l’intersection entre infrastructure IT, IA générative et transformation digitale des entreprises. J’aide les décideurs et les équipes techniques à naviguer dans l’écosystème tech sans bullshit marketing.