Temps de lecture : 4 min

Ce qu’il faut retenir

- Pollution : L’IA génère une avalanche de faux rapports de sécurité qui épuise les mainteneurs bénévoles de projets critiques.

- Outil : Utilisée avec rigueur, comme chez Anthropic et Mozilla, elle devient un accélérateur puissant pour la détection de vulnérabilités.

- Responsabilité : La vérification humaine reste non négociable. Le code généré par IA contient 1,7 fois plus de problèmes et ralentit les développeurs de 19%.

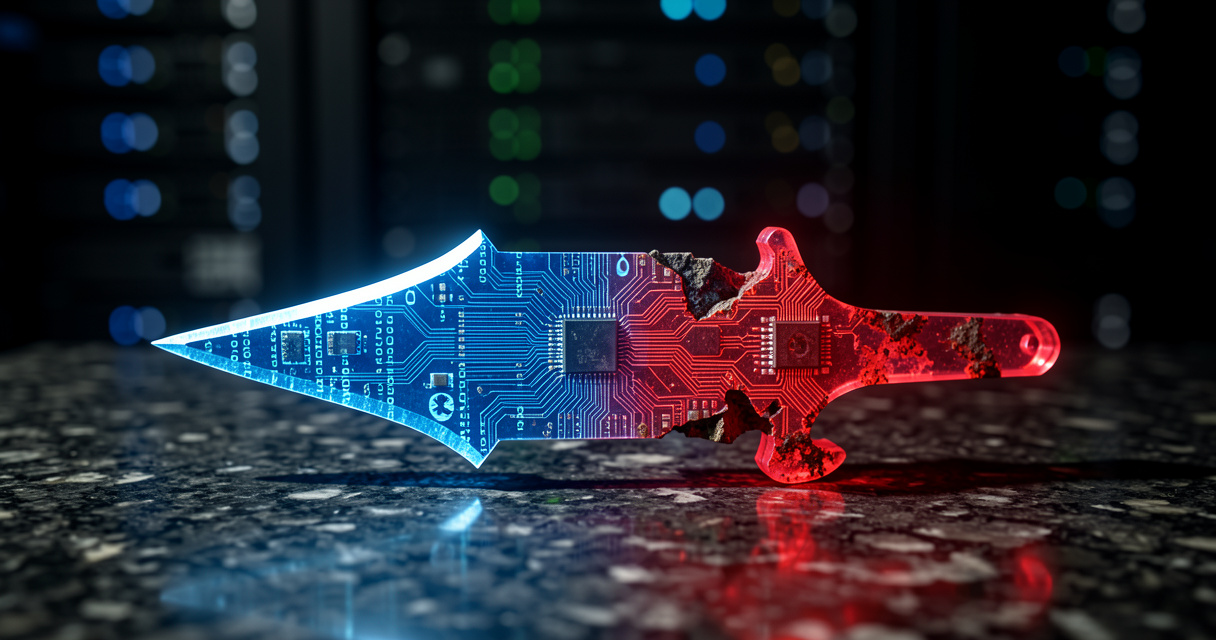

L’IA dans la sécurité open source : le double tranchant

Sur le terrain de la sécurité open source, l’intelligence artificielle est devenue une lame à double tranchant. D’un côté, elle promet d’automatiser des tâches fastidieuses et de déceler des failles invisibles. De l’autre, elle engendre une pollution informationnelle qui menace l’écosystème. En pratique, tout dépend de son utilisation. Passons au concret.

Le cas d’école : Firefox et l’approche rigoureuse

Un exemple positif vient du partenariat entre Mozilla et Anthropic. L’équipe Frontier Red Team d’Anthropic a déployé son modèle Claude Opus 4.6 sur le code de Firefox. Ce qui compte vraiment ici, ce n’est pas juste la détection, mais la méthodologie. En deux semaines, ils ont identifié plus de bogues de haute gravité que les utilisateurs n’en rapportent habituellement en deux mois.

Mais la clé du succès réside dans la suite : Anthropic a fourni à Mozilla des cas de test minimaux et reproductibles pour chaque faille. Sans langue de bois, cette rigueur a permis aux ingénieurs de vérifier et de déployer des correctifs en quelques heures. L’IA devient alors un véritable multiplicateur de force pour les équipes de sécurité.

L’avalanche toxique : le cauchemar des mainteneurs

À l’opposé, je constate une réalité bien plus sombre sur des projets comme cURL. Son créateur a témoigné d’un phénomène inquiétant : l’IA a supprimé la friction nécessaire à la soumission d’un rapport de sécurité valide. Décortiquons ça.

Avant 2025, environ un rapport sur six était sérieux. Aujourd’hui, ce taux est tombé à un sur vingt, voire trente. Les mainteneurs sont submergés par un DDoS informationnel de faux positifs générés à la chaîne. Leur temps et leur motivation, des ressources précieuses et limitées, sont gaspillés dans un tri incessant. Sur le terrain, cette surcharge crée un risque systémique : à force de bruit, une alerte critique pourrait passer inaperçue.

Le mauvais exemple : Google et le signalement futile

Le problème n’est pas que quantitatif, il est aussi qualitatif. Prenons le cas de Google et du projet FFmpeg. Le géant a utilisé l’IA pour signaler une multitude de problèmes… parfaitement insignifiants. Je parle de bugs de lecture sur des jeux vidéo de 1995.

Pour une équipe de bénévoles, traiter ces futilités représente une charge insoutenable, d’autant que Google ne finance pas les corrections. C’est l’illustration parfaite d’une approche déconnectée des réalités opérationnelles des projets open source. L’IA, sans discernement ni engagement, devient un outil de nuisance.

La vision pragmatique de Linux et de l’écosystème

Du côté de Linux, la philosophie est plus pragmatique. Linus Torvalds voit dans l’IA un outil d’aide à la maintenance, pas un rédacteur de code. L’accent est mis sur la vérification automatisée des correctifs, une tâche ingrate mais essentielle.

Dans la communauté, un consensus se dégage. Des outils comme AUTOSEL ou le workflow CVE interne de Linux intègrent déjà l’IA pour automatiser le tri et le routage. En pratique, cela élimine le travail de fourmi sans remplacer le jugement de l’expert. Comme le rappelle un ingénieur d’Intel, il est crucial de « montrer son travail ». Un développeur doit toujours comprendre le code qu’il soumet, IA ou pas.

Analyse coût/bénéfice : les chiffres qui dérangent

Passons aux données concrètes. Une étude récente montre que le code généré par l’IA présente 1,7 fois plus de problèmes que le code humain. Pire, les développeurs équipés d’outils d’IA seraient 19% plus lents, car le temps de révision et de correction explose.

Le risque, comme l’a souligné une responsable AWS, est une pollution logicielle et une dévalorisation de la contribution open source. Si n’importe qui peut générer une pull request en un clic, quelle est la valeur de la pousser en amont ? Sans rigueur, l’écosystème risque de s’effondrer sous le poids d’un code médiocre et de rapports inutiles.

Conclusion : pour une alliance exigeante

Ce qui compte vraiment en 2026, ce n’est pas d’être pour ou contre l’IA. C’est d’imposer des garde-fous. L’IA et l’open source peuvent former une alliance puissante, à trois conditions :

- Une méthodologie rigoureuse : fournir des preuves reproductibles, comme le fait Anthropic.

- Un respect des ressources : ne pas inonder les projets bénévoles de signalements futiles.

- Une responsabilité humaine préservée : l’IA est un assistant, pas un pilote. La compréhension et la vérification finales sont non négociables.

Sans cette discipline, l’outil se transforme en arme. L’avenir de la sécurité open source dépend de notre capacité à utiliser l’IA avec autant de pragmatisme que de prudence.

Ingénieur systèmes et architecte cloud pendant 8 ans chez un leader européen de l’hébergement, reconverti dans l’analyse tech et business. Passionné par l’intersection entre infrastructure IT, IA générative et transformation digitale des entreprises. J’aide les décideurs et les équipes techniques à naviguer dans l’écosystème tech sans bullshit marketing.